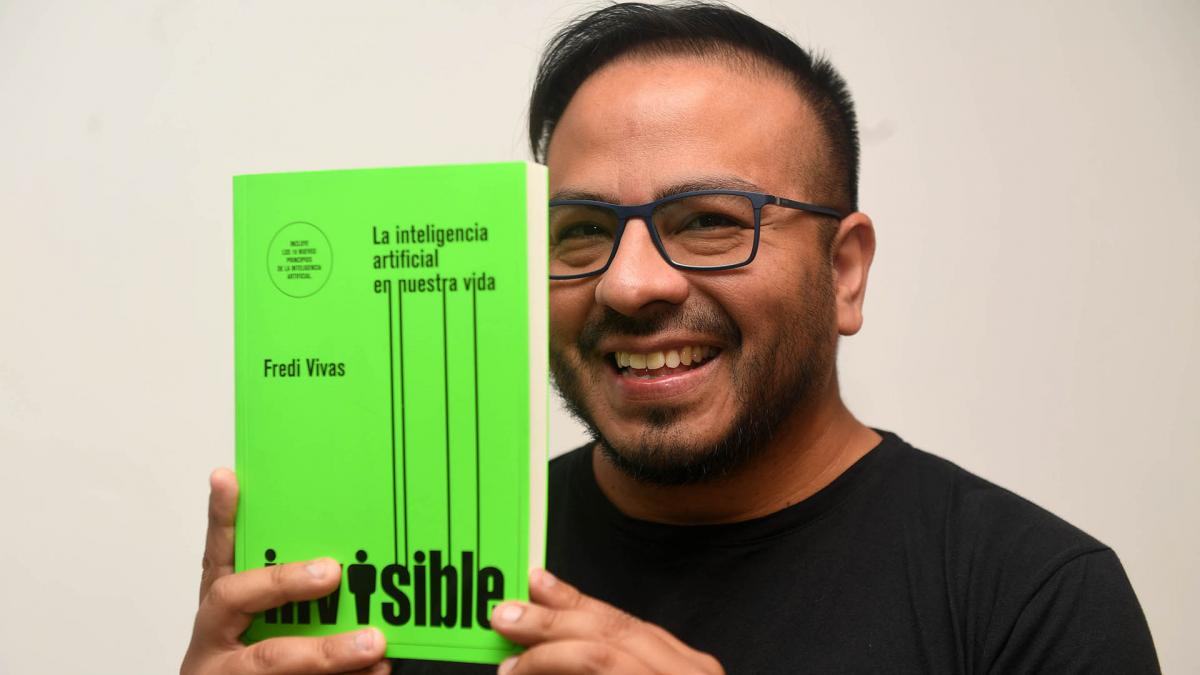

En las entrelíneas de siete relatos de ficción científica que cuentan el devenir de un robot obsoleto, un país gobernado por máquinas o las habilidades de una robot capaz de ayudar a un chico cansado del bullying, el emprendedor y tecnólogo Fredi Vivas, quien lleva más de quince años trabajando con desarrollos de inteligencia artificial, plantea en su nuevo libro «Invisible» distintas reflexiones sobre el impacto ético de los algoritmos, los apagones digitales y la obsolescencia en la vida diaria.Vivas estudió Ingeniería en Sistemas en la UTN y llegó a cursar el Global Solutions Program en Singularity University de Estados Unidos. Es CEO y fundador de RockingData, una startup pionera que trabaja junto a empresas de distintas industrias para identificar formas innovadoras de usar los datos.

Autor del libro «Cómo piensan las máquinas?» (Galerna), le gusta pensar la inteligencia artificial como una disciplina que dialoga con las humanidades. En su equipo hay filósofos y politólogos porque está convencido de que un enfoque más amplio de la tecnología permite mejorar los desarrollos. «Esa mirada nos ayuda a entender cómo aprendemos, cómo incorporamos y creamos conocimiento. Eso es algo que siempre se dejó para los humanos y ahora lo estamos tratando de trasladar a las máquinas», sostiene y advierte que cree que la expresión «inteligencia artificial es un poco injusta», dice.

«Más preciso sería `inteligencia computacional´, inteligencia hecha por códigos de programación. Repensar qué nos define como humanos, en qué somos muy buenos, en qué tenemos que mejorar. Cuando decimos que una inteligencia artificial discrimina, ya sea por reconocimiento facial o en una búsqueda laboral, en definitivamente es un razonamiento muy simplificador: llevamos décadas discriminando, ese sesgo está en nosotros antes que en los algoritmos, es un sesgo histórico», analiza. Para él, la complejidad del presente de las máquinas exige un trabajo de reflexión, reglamentación y pulido: «Tal vez en el futuro se de una paradoja en medio de tanto miedo e incertidumbre y la búsqueda de mejores estándares en los algoritmos nos permita pensar en una sociedad más justa. Todavía veo una ciudadanía digital muy baja en la sociedad: a los diez años, se le enseña a un niño a cruzar bien y a no tirar la basura, pero es complejo asesorarlos sobre el uso del celular y sus riesgos«.

En «Invisible» (Sudamericana), los relatos funcionan como una excusa o una puerta de entrada para poder repensar la inteligencia artificial en un marco más familiar que permite asomarse a los grandes debates del futuro. Con ecos y referencias cruzadas a la obra de Arthur C. Clarke, Julio Verne o Asimov, Vivas propone que el diálogo entre ficción y realidad permite ampliar el entendimiento sobre el futuro. «Evidentemente, los productos culturales que consumimos a lo largo de nuestra vida marcan nuestro modo de ver el mundo y de transmitir conocimiento. Porque, en definitiva, lo que estoy buscando en estas páginas es -además de cumplirle un sueño a mi yo de 12 años- transmitir lo que aprendí en más de una década trabajando en inteligencia artificial», asume en las primeras páginas del libro editado por Penguin Random House.

– ¿Por qué recurriste a la ficción para escribir un libro de inteligencia artificial? ¿Cuál fue la apuesta?

– Primero, me gusta mucho la ciencia ficción, un género que descubrí en mi infancia. Pero además, hace relativamente poco me topé con el concepto de «ficción realista»: algo que es ciencia ficción, pero que podría pasar tranquilamente en la realidad. Y me enteré que, por ejemplo, en Stanford, dan clases de ciencia ficción. ¿Cuáles son los elementos de la ciencia ficción que permiten que podamos imaginarnos situaciones complejas o con muchas variables de posibilidad de ocurrencia de cosas, no? Creo que ese mecanismo es una herramienta muy interesante y divertida para encarar el presente. Y cuando difundo lo que hago me interesa realmente llegar: que un chico que está tiene 17 o 18 años y que está en el colegio se acerque a un cuento y que, en el medio de esa lectura de ficción, encuentre conceptos que le llamen la atención, que empiece a curiosear, que lo googlee y que le despierte curiosidad.

«Vivimos sobreinformados y, ante eso, lo más importante es mantenernos curiosos»

Vivimos sobreinformados y, ante eso, lo más importante es mantenernos curiosos. Los medios tradicionales suelen abordar la inteligencia artificial con enfoques que inducen al miedo, a la incertidumbre y al famoso FOMO (del inglés «fear of missing out», «temor a perderse algo»). ¿Quién va a leer un libro de ingeniería sobre inteligencia artificial, un libro técnico de software? Ya no hay tanto espacio para eso en un momento en el que todos están hablando de inteligencia artificial. Pero además, creo que también es un homenaje a la ciencia ficción: sin exagerar, creo que me dedico a la ingeniería gracias a la ciencia ficción, me marcaron mucho las series y las películas que vi. En mi casa no había nadie que estudiara computación o tecnología, pero sí pude ver películas como Cortocircuito o Blade Runner o leer la revista Muy Interesante y eso despertó mi curiosidad. El libro es un intento de abrir un camino similar.

– En los agradecimientos, esa referencia se vuelve explícita. «Hacia fines de los 80 mi hermano mayor, Gary, empezó a repartir revistas con un amigo los fines de semana. Entre ellas, la Muy Interesante. En casa a veces lo ayudábamos sellando algunas y dejándolas listas para el reparto. No sé quién le habrá dado ese trabajo a mi hermano. Fue mi primer contacto con la ciencia y la tecnología», contás. ¿Cómo comenzó ese recorrido?

– Mi infancia transcurrió a fines de los ochenta, en Lomas de Zamora, pleno conurbano bonaerense, «Camino Negro al fondo» como solemos decir. Ahí no había bibliotecas y para llegar a la más cercana había que ir hasta el centro de Lomas: caminar cinco cuadras y tomar un colectivo por 40 minutos. No había tele por cable, no había internet y en mi casa no tenía muchos libros más que esas enciclopedias que se pagaban en cuotas. Pero yo leía todo lo que me llegaba, cualquier cosa. Leer fue como un milagro.

«La inteligencia artificial no deja de ser un código de programación super avanzado y eso, lógicamente, me sigue generando interrogantes»

Mi hermano tuvo ese trabajo temporal de repartir Muy Interesante y las revistas empezaron a llegar a mi casa. En ese momento se despertó mi interés por la computación. Mi padre era marinero y había traído una computadora que nunca anduvo pero yo me la pasaba jugando como si verdaderamente estuviera haciendo algo con ella. Mi hermana me ayudó e incentivó: me inscribió en un instituto de computación de Lomas y así arranqué a los doce años. Saber cómo funciona una computadora o cómo lograr algo nuevo con una computadora me generaron una curiosidad y una pasión que conservo, sigo pensando como ese nene en algún punto y es un buen punto de partida. La inteligencia artificial no deja de ser un código de programación super avanzado y eso, lógicamente, me sigue generando interrogantes.

– Recién hiciste referencia a la angustia y la ansiedad que despierta la innovación en materia de inteligencia artificial. ¿Cómo puede lidiar con esos sentimientos alguien que no está tan familiarizado con el tema aún?

– El concepto de FOMO lo escuché por primera vez en Estados Unidos, hace como siete años, mientras estaba estudiando. Y en aquel momento, me di cuenta de que yo no sentía eso y me pregunté por qué pasaba eso…Y creo que es por algo que aprendí hace algún tiempo: hay que elegir a donde uno se mete. Me pasó con la tecnología cripto, con el metaverso, impresión 3D o realidad virtual…Uno cuando consulta a un traumatólogo busca la especialidad y esto es igual. La tecnología del software evolucionó muchísimo en los últimos 20 años, probablemente sea la rama de estudio de la ciencia que más avanzó. Creo que para poder lidiar con esa velocidad hay que encontrar una especialización y cierta comodidad. Por ahora me atrapa el mundo de la ciencia de datos: cómo tomar decisiones con datos y cómo hacer máquinas que sean inteligentes para ayudar a tomar una mejor decisión. Hay cosas que no sé, que no voy a saber y eso no me da vergüenza porque es precisamente por eso que sí sé de otras cosas. Y creo que esto apunta a algo un poco más complejo: en el futuro vamos a tener que «curar» mucho mejor el contenido que nos metemos en el cerebro. Muchas malas noticias, fotos adulteradas, violencia, confrontación…todo eso necesariamente impacta en nuestra forma de ver el mundo. Y bueno, hoy todos quieren saber de todo, saberlo rápido y eso en definitiva no funciona.

– El libro cierra con una propuesta para reemplazar las famosas Leyes de Asimov, que oficiaron como base jurídica fundamental durante décadas para regir la relación entre máquinas y humanos, por otros nuevos diez principios. ¿Por qué se te ocurrió esa reformulación? ¿En qué medida son hoy obsoletas?

– Siempre me gustó pensar en cómo en el pasado imaginaban el futuro. La Feria del Futuro en Estados Unidos prometía autos volando…Algunas cosas se dieron, otras están pasando y algunas no se cumplieron. Pero esos futuros eran «físicos»: un robot mayordomo, super fábricas, autos voladores… Y esos futuros imaginarios no se dieron, hubo una revolución de las máquinas invisibles que superaron en número y en funcionalidades a las máquinas visibles. La revolución de la inteligencia artificial generativa llegó a millones de personas y eso empieza a generar «problemas», nos enfrentamos a situaciones que no habíamos ni imaginado y que quedaron por fuera de la realidad que trazó (Isaac) Asimov. Vemos una foto y no sabemos si es real, podemos interactuar con un asistente telefónico sin saber que es artificial y hay muchísimas cosas que dejaremos de hacer porque las máquinas las harán mucho mejor que nosotros. Todos estos problemas requieren de nuevas leyes -en Europa ya están trabajando en un marco legal de este tipo- pero además vamos a necesitar de principios para que la inteligencia artificial beneficie a la sociedad. La inteligencia artificial tiende rápidamente a volverse invisible ante nuestros ojos, de responsabilidad humana, de privacidad, de frecuencia de uso y de explicabilidad débil porque los seres humanos tenemos derecho a conocer la lógica de razonamiento de las máquinas que llegan a tomar decisiones que puedan afectarnos.