La IA generativa es, según ChatGPT (el chatbot más popular del mundo), “se centra en la creación de sistemas capaces de generar nuevos datos, imágenes, texto o incluso música que parecen haber sido creados por humanos”.

“ChatGPT es un ejemplo de programa capaz de sostener diálogos diversos en lenguaje natural, entrenado con técnicas donde participan humanos, tanto en el acceso a conversaciones de las cuales aprender como en el proceso posterior de evaluar e ir mejorando las interacciones”, explica a Clarín Javier Blanco, Doctor en Informática por la Universidad de Eindhoven, Holanda.

A partir de este concepto, diversos usos comenzaron a aparecer: desde escribir correos electrónicos laborales hasta hacer ensayos para la facultad, pasando por escritos legales, todo el mundo comenzó a sacar provecho de esta tecnología. Con las consecuentes advertencias de los expertos.

“Estos sistemas de generación artificial están basados en arquitecturas llamadas redes generativas antagónicas (GAN, por sus siglas en inglés). En general, los sistemas de aprendizaje maquínico producen programas clasificadores o discriminadores a partir del entrenamiento con grandes cantidades de datos. El reconocimiento facial es realizado por programas de este tipo”, agrega el experto.

Este tipo de sistemas, posibilitados por el impresionante avance del poder de cómputo, constituye una disciplina que toma grandes volúmenes de datos ya disponibles para construir un programa que pueda reconocer patrones comunes y crear datos nuevos, a partir de un entrenamiento humano (GPT: Generative Pre-training Transformer).

Las ventajas asociadas a estos sistemas van desde el ahorro de tiempo hasta la imitación de capacidades que no se tienen por parte de los usuarios, desde redactar textos hasta acompañarlos con imágenes. Sin embargo, en el ámbito de la ciberseguridad hay advertencias que muchos expertos señalan para tener en cuenta.

Qué desafíos presenta la IA generativa

“La IA Generativa presenta riesgos particulares que deben abordarse de manera cuidadosa para garantizar su uso ético y seguro. Estos riesgos incluyen desde la moderación del contenido que suben los usuarios, hasta aquel engañoso, sesgado o perjudicial para evitar la manipulación de información”, menciona David González Cuautle, Investigador de Seguridad Informática de ESET Latinoamérica.

Desde la empresa de ciberseguridad con sede en Eslovaquia, advierten cinco puntos que se irán tornando más conflictivos con el paso del tiempo. Y que, en la actualidad, ya representan un problema. Explican expertos de la compañía:

1. Moderación de contenidos: Algunas de las redes sociales, sitios web o aplicaciones no son legalmente responsables, o son muy ambiguos, en lo que refiere a los contenidos subidos por sus usuarios, como ideas o publicaciones hechas por terceros o subyacentes, ni el contenido generado por IA: aun cuando cuentan con términos de uso, normas de comunidad y políticas de privacidad que protejan los derechos de autor, hay un vacío legal que sirve de blindaje para los proveedores ante una violación de derechos de autor.

El usuario cuenta con un fácil acceso y una enorme disponibilidad de herramientas de IA Generativa que son poco claras, incluso contradictorias, en sus políticas de uso e implementación.

2. Infracción de los derechos de autor e imagen: En los Estados Unidos, en mayo 2023, una Huelga del Sindicato de Guionistas, comenzó una serie de conflictos al que se le unieron en julio del mismo año el Sindicato de Actores en Hollywood. Las principales causas de este movimiento se debieron a la petición de un aumento salarial derivado del auge de las plataformas digitales, ya que hubo un incremento en la demanda/creación del contenido y buscaban que las ganancias fueran repartidas proporcionalmente entre guionistas/actores y las grandes compañías.

Otro motivo fue el abuso de la IA Generativa por parte de estas compañías para producir contenido sin el consentimiento del actor o actriz de usar su rostro y voz para fines comerciales, por lo que solicitaron un nuevo contrato que los protegiera de la explotación de su identidad y talento sin su consentimiento ni remuneración para esta tecnología. La originalidad de algún contenido independientemente de la fuente, con la llegada de la IA Generativa cada vez parece ser más difusa. En este caso, muchos derechos de autor y permisos de imagen fueron ignorados por grandes compañías, generando una enorme molestia y como consecuencia de esto Estados Unidos optó por implementar recursos legales que protegieran a ambas partes.

3. Privacidad: Para que los modelos de IA Generativa puedan funcionar correctamente necesitan de grandes volúmenes de datos para ser entrenados, pero ¿qué sucede cuando este volumen puede obtenerse de cualquier fuente pública como videos, audios, imágenes, textos o códigos fuente sin el consentimiento del titular?

Hay aplicaciones para «desvestir» usuarios en imágenes. Foto Archivo

Hay aplicaciones para «desvestir» usuarios en imágenes. Foto Archivo4. Cuestiones éticas: Aquellos países donde las regulaciones en materia de IA son escasas o nulas, son aprovechadas por algunos usuarios para fines nada éticos como la suplantación de identidad (voz, imagen o video) para crear perfiles falsos que usan para cometer fraude/extorsión a través de alguna plataforma, aplicación o red social, o también lanzar campañas de phishing sofisticadas o estafas del tipo catfishing.

5. Desinformación: Aprovechando este tipo de IA las prácticas de difusión de noticias falsas en plataformas y redes sociales se ven mejoradas. La viralización de estos contenidos engañosos generados llega a perjudicar la imagen de alguna persona, comunidad, país, gobierno o empresa.

IA: qué cuidados tener

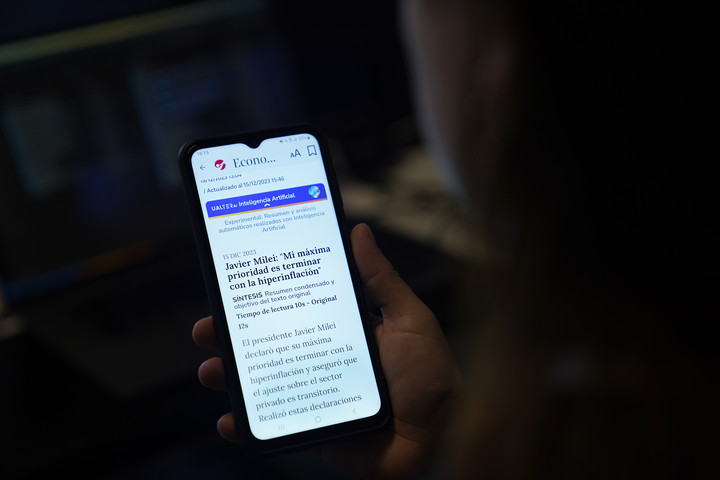

Clarín tiene un sistema que resume notas por IA. Foto Clarín

Clarín tiene un sistema que resume notas por IA. Foto ClarínHay algunos problemas más profundos que, en rigor, no tienen forma de ser prevenidos a nivel individual, como es el caso de la desinformación. Sin embargo, en ámbitos donde el usuario tiene un cierto nivel de control, ESET recomienda:

Filtrado y moderación efectiva: Desarrollar sistemas de filtrado y moderación robustos que puedan identificar y eliminar contenido inapropiado, engañoso o sesgado generado por modelos de IA Generativa. Esto ayudará a mantener la integridad de la información y a prevenir posibles consecuencias negativas.

Entrenamiento con datos éticos y diversificados: Garantizar que los modelos de IA Generativa se entrenen con conjuntos de datos éticos, imparciales y representativos. La diversificación de los datos contribuye a reducir sesgos y a mejorar la capacidad del modelo para generar contenido más equitativo y preciso.

Transparencia en la regulación del contenido: Establecer regulaciones que permitan a los usuarios comprender cómo se genera el contenido, el tratamiento que reciben los datos y las implicaciones que puede llegar a tener en caso de no cumplir.

Evaluación continua de la ética y la calidad: Implementar mecanismos de evaluación continua para monitorear la ética y la calidad del contenido generado. Estos mecanismos pueden incluir auditorías regulares, pruebas de robustez y colaboración con la comunidad para identificar y abordar posibles problemas éticos.

Educación y conciencia pública: Promover la educación y la conciencia pública sobre los riesgos asociados con la IA Generativa. Fomentar la comprensión de cómo funcionan estos modelos y cuáles son sus posibles impactos permitirán al usuario participar activamente en la discusión y en la exigencia de prácticas éticas por parte de los desarrolladores y empresas.

Como sea, la inteligencia artificial generativa, llevada a un plano masivo, empieza a generar problemas y planteos nuevos que personalidades como Elon Musk han llegado a advertir. La forma en la cual se desenvuelvan será, a fin de cuentas, responsabilidad no sólo de las big tech sino también de los distintos sectores de la sociedad.